Tecnologia Científica

Especialistas em IA de Stanford fazem previsões sobre o que acontecerá em 2026

A era do evangelismo da IA está dando lugar à avaliação. O corpo docente de Stanford prevê um próximo ano marcado pelo rigor, transparência e foco na utilidade real em vez de promessas especulativas.

Após anos de rápida expansão e investimentos bilionários, 2026 pode marcar o momento em que a inteligência artificial confronta sua real utilidade. Em suas previsões para o próximo ano, professores de Stanford das áreas de ciência da computação, medicina, direito e economia convergem para um tema marcante: a era do evangelismo da IA está dando lugar a uma era de avaliação da IA. Sejam parâmetros padronizados para raciocínio jurídico, painéis de controle em tempo real para monitorar a substituição de mão de obra ou estruturas clínicas para avaliar a enxurrada de startups de IA médica, o próximo ano exige rigor em vez de exageros. A questão não é mais "A IA pode fazer isso?", mas sim "Quão bem, a que custo e para quem?".

Saiba mais sobre o que o corpo docente do programa HAI de Stanford espera para o próximo ano.

Soberania da IA, crescimento global

James Landay , codiretor do HAI, professor de Ciência da Computação e professor titular da Cátedra Anand Rajaraman e Venky Harinarayan na Escola de Engenharia.

Minha maior previsão? Não haverá IAG (inteligência artificial geral) este ano.

Mas, além disso, a soberania da IA ganhará grande impulso este ano, à medida que os países buscam demonstrar sua independência em relação aos fornecedores de IA e ao sistema político dos Estados Unidos. O que é soberania da IA? Em um modelo de soberania, um país pode construir seu próprio grande LLM (Learning Learning Machine - Máquina de Aprendizado de Máquina). Em outro exemplo, um país pode executar o LLM de terceiros em suas próprias GPUs para garantir que seus dados não saiam do país. O termo "soberania" não é bem definido, e a HAI (Helping Association of India - Instituto de Inteligência Artificial) está trabalhando em um projeto para ajudar as pessoas a entenderem esses diferentes modelos e fornecer algumas análises.

Obviamente, vimos em 2025 muitos investimentos em enormes centros de dados ao redor do mundo, seja nos Emirados Árabes Unidos em maio ou na Coreia do Sul no outono. Provavelmente veremos organizações como a Nvidia e a OpenAI realizando visitas a outros países, o que está relacionado à soberania da IA e como elas podem obter vantagem. Veremos esses investimentos contínuos em centros de dados de IA em 2026. Mas, em algum momento, não se pode concentrar todo o dinheiro do mundo em uma única coisa. Parece uma bolha muito especulativa.

"A soberania da IA ganhará grande impulso este ano, à medida que os países demonstrarem sua independência em relação aos fornecedores de IA e ao sistema político dos EUA."

James Landay

Stanford HAI Denning CoDiretor

Além disso, em 2026, ouviremos mais empresas dizerem que a IA ainda não demonstrou aumentos de produtividade, exceto em certas áreas específicas, como programação e call centers. Ouviremos falar de muitos projetos de IA fracassados. Agora, será que as pessoas aprenderão com esses fracassos e descobrirão onde aplicar a IA de forma adequada, obtendo mais sucesso este ano? Talvez.

Acho que veremos algumas novas IAs de interface de usuário personalizadas, coisas que vão além do chatbot ou até mesmo deste navegador web lançado pela OpenAI. Acho que neste ano novo veremos prévias dessas tecnologias, se não produtos já existentes.

Além disso, há a questão da assintótica. Temos modelos enormes, mas já vimos modelos melhores que são menores do que esses modelos gigantes. Parece que atingimos um pico de dados, tanto porque estamos ficando sem dados quanto porque os dados são de baixa qualidade. Prevejo que haverá um esforço muito maior na curadoria de conjuntos de dados realmente bons, porém menores, e na criação de modelos que tenham um desempenho melhor com dados menores.

Obviamente, houve muitos avanços em vídeo com IA em 2025, mas eles não foram muito bons. Em uma das minhas aulas, porém, uma equipe de alunos usou IA para fazer um vídeo que normalmente teria atores e locações especiais. Teve alguns problemas, mas ficou muito bom. Acho que isso significa que as ferramentas de vídeo finalmente melhoraram o suficiente para vermos usos reais, e veremos isso decolar no ano que vem. Além disso, veremos muito mais problemas com direitos autorais.

Abrir a caixa preta é a próxima missão da ciência

Russ Altman , professor titular da Cátedra Kenneth Fong na Escola de Engenharia e professor de Bioengenharia, Genética, Medicina e Ciência de Dados Biomédicos, além de pesquisador sênior do Instituto de Pesquisa em Saúde de Stanford (HAI).

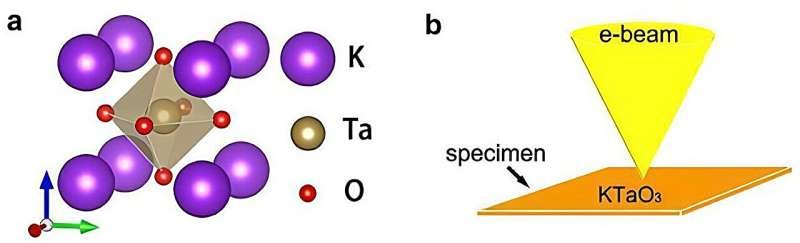

Vejo um enorme potencial nos modelos fundamentais para desvendar descobertas e previsões na ciência e na medicina. Atualmente, existem diversas abordagens para a construção desses modelos. Por exemplo, os desenvolvedores podem construir um modelo massivo de "fusão inicial" incorporando todos os tipos de dados, ou podem construir um modelo de "fusão tardia", onde criam modelos separados para cada modalidade e os integram posteriormente. Vejo algumas questões profundas em torno disso. Os modelos construídos separadamente funcionarão bem juntos? O que acontece quando alguns dados são ruins? Se você tiver um modelo de fusão tardia, onde, digamos, combinou vários modelos, incluindo DNA, RNA e proteínas, você poderia simplesmente reconstruir o módulo de DNA sem precisar reconstruir os outros. No entanto, com um modelo de fusão inicial, você precisa reconstruir tudo sempre que houver uma atualização. Minha previsão é que, no próximo ano, poderemos ter clareza sobre qual abordagem, fusão inicial ou fusão tardia, é a melhor.

"Prevejo um maior foco na arqueologia das redes neurais de alto desempenho."

Russ Altman

Membro Sênior do HAI

Além disso, as pessoas estão descobrindo o incrível poder da IA na pesquisa científica. Mas, na ciência, você precisa de mais do que apenas uma previsão precisa; você precisa entender como o modelo chegou a essa previsão. Nos laboratórios científicos, há um foco crescente não na saída do modelo, mas na rede neural interna que leva ao desempenho, no mapa de atenção que mostra quais dados estão prestando atenção a quais outros dados.

Em 2026, espero um foco maior na arqueologia das redes neurais de alto desempenho. Acabamos de publicar um artigo sobre isso intitulado " Prestando atenção à atenção em proteínas ". Estou vendo pessoas usando recursos chamados autoencoders esparsos em redes profundas para tentar identificar as características nos dados que impulsionam o desempenho. Na ciência, existe um imperativo absoluto para desvendar a caixa-preta da IA, e estou começando a ver essa caixa sendo aberta.

Analisando a IA e o setor de saúde, vimos no ano passado um grande volume de investimentos em startups que utilizam IA na medicina. Um hospital típico é inundado pelo interesse de startups que querem vender uma solução para determinado problema. Cada uma dessas soluções individuais não é descabida, mas, em conjunto, elas representam um tsunami de informações que atinge os executivos. Este ano, espero que comecemos a desenvolver maneiras de avaliar o impacto de um sistema de IA, suas características técnicas, sua população de treinamento, como implementá-lo, sua eficiência ou impacto disruptivo para a equipe, seu retorno sobre o investimento no fluxo de trabalho hospitalar, a satisfação do paciente e a qualidade das decisões. Todo esse processo está começando a ser compreendido aqui em Stanford, liderado em parte pelo Cientista de Dados Chefe do Hospital Stanford, Nigam Shah. Mas precisamos disponibilizar essa tecnologia também em mercados menos familiarizados com tecnologia ou com menos recursos.

A IA jurídica se volta para o ROI, o rigor e o raciocínio multidocumental

Julian Nyarko , Professor de Direito e Diretor Associado do Stanford HAI

Prevejo que dois temas poderão definir o ano no domínio da IA para o setor de serviços jurídicos. Primeiro, rigor e ROI (retorno sobre o investimento). Escritórios de advocacia e tribunais poderão deixar de perguntar "Consegue escrever?" e começar a perguntar "Quão bem, sobre o quê e com que risco?". Espero que avaliações mais padronizadas e específicas do domínio se tornem requisitos básicos, vinculando o desempenho do modelo a resultados jurídicos tangíveis, como precisão, integridade das citações, exposição a privilégios e tempo de resposta. Também poderá haver um foco maior nos ganhos de eficiência dentro dos fluxos de trabalho reais (gestão de documentos, faturamento e sistemas de conhecimento) em vez de em cenários artificiais controlados. Segundo, a IA assumirá tarefas mais complexas. Além da triagem inicial e das primeiras versões, já começamos a ver uma mudança em direção a sistemas que lidam, por exemplo, com o raciocínio multidocumental: sintetizando fatos, mapeando argumentos e revelando contra-autoridades com proveniência. Essa mudança exige novas estruturas de mensuração – como o modelo de advogado com perfil de juiz e a classificação de preferências por pares – para avaliar tarefas jurídicas complexas em larga escala. Indicadores emergentes como o GDPval, construídos em torno dessas ideias, podem direcionar os roteiros de desenvolvimento para tarefas de ordem superior.

Desinflar a bolha da IA

Angèle Christin , Professora Associada de Comunicação e Pesquisadora Sênior do Instituto de Pesquisa em Saúde e Inclusão de Stanford (HAI)

Os outdoors em São Francisco dizem tudo: IA em todo lugar!!! Para tudo!!! O tempo todo!!! O tom um tanto frenético desses anúncios transmite a ideia das esperanças – e dos imensos investimentos – depositados na IA generativa e nos agentes de IA.

Até o momento, os mercados financeiros e as grandes empresas de tecnologia têm investido fortemente em IA, gastando enormes quantias de dinheiro e capital humano, e construindo infraestruturas computacionais gigantescas para sustentar o crescimento e o desenvolvimento da IA. No entanto, já existem sinais de que a IA pode não alcançar tudo o que esperamos. Há também indícios de que a IA, em alguns casos, pode desviar a atenção, desqualificar pessoas e prejudicá-las. E existem dados que mostram que a atual expansão da IA ??acarreta custos ambientais enormes.

Espero que vejamos mais realismo sobre o que podemos esperar da IA. A IA é uma ferramenta fantástica para algumas tarefas e processos; é problemática para outros (olá, alunos gerando redações finais sem ler os textos!). Em muitos casos, o impacto da IA provavelmente será moderado: algum ganho de eficiência e criatividade aqui, algum trabalho extra e tedioso ali. Estou particularmente animado para ver estudos empíricos mais detalhados sobre o que a IA faz e o que ela não pode fazer. Isso não significa necessariamente que a bolha vai estourar, mas talvez ela não vá crescer muito mais.

"Veremos mais realismo sobre o que podemos esperar da IA."

Angèle Christin

Membro Sênior do HAI

Um "momento ChatGPT" para a IA na medicina

Curtis Langlotz , Professor de Radiologia, de Medicina e de Ciência de Dados Biomédicos, Vice-Reitor Associado Sênior de Pesquisa e Pesquisador Sênior do Instituto de Pesquisa em Saúde de Stanford (Stanford HAI).

Até recentemente, o desenvolvimento de modelos de IA médica era extremamente caro, exigindo dados de treinamento rotulados por especialistas médicos bem remunerados (por exemplo, classificando uma mamografia como benigna ou maligna). Novos métodos de aprendizado de máquina autossupervisionado, agora amplamente utilizados por desenvolvedores de chatbots comerciais, não exigem rótulos e reduziram drasticamente o custo do treinamento de modelos de IA médica.

Os pesquisadores de IA médica têm sido mais lentos em reunir os conjuntos de dados massivos necessários para aproveitar a autossupervisão devido à necessidade de preservar a privacidade dos dados dos pacientes. Mas o aprendizado autossupervisionado a partir de conjuntos de dados um pouco menores tem se mostrado promissor em radiologia , patologia , oftalmologia , dermatologia , oncologia , cardiologia e muitas outras áreas da biomedicina .

Muitos de nós nos lembraremos do momento mágico em que descobrimos as incríveis capacidades dos chatbots treinados com autossupervisão. Em breve, presenciaremos um "momento ChatGPT" semelhante para a IA na medicina, quando modelos de IA forem treinados com dados massivos e de alta qualidade da área da saúde, em uma escala que rivaliza com a dos dados usados para treinar chatbots. Esses novos modelos biomédicos fundamentais aumentarão a precisão dos sistemas de IA médica e possibilitarão o desenvolvimento de novas ferramentas para diagnosticar doenças raras e incomuns, para as quais os conjuntos de dados de treinamento são escassos.

Da expectativa aos painéis de controle: Medindo a IA em tempo real

Erik Brynjolfsson , Diretor do Laboratório de Economia Digital, Professor Cátedra Jerry Yang e Akiko Yamazaki, e Pesquisador Sênior do Instituto de Pesquisa em Saúde e Inovação de Stanford (HAI) e do Instituto de Pesquisa em Economia e Inovação de Stanford (SIEPR).

Em 2026, as discussões sobre o impacto econômico da IA finalmente darão lugar a uma mensuração cuidadosa. Veremos o surgimento de "painéis econômicos de IA" de alta frequência que monitorarão, em nível de tarefa e ocupação, onde a IA está impulsionando a produtividade, substituindo trabalhadores ou criando novas funções. Usando dados de folha de pagamento, plataforma e uso, essas ferramentas funcionarão como contas nacionais em tempo real. Em nosso trabalho " Canários na Mina de Carvão " com a ADP, já observamos trabalhadores em início de carreira em ocupações expostas à IA experimentando resultados de emprego e renda mais fracos; em 2026, indicadores semelhantes serão atualizados mensalmente, e não anos depois. Executivos verificarão diariamente as métricas de exposição à IA juntamente com os painéis de receita, e os formuladores de políticas as usarão para direcionar treinamento, redes de proteção social e políticas de inovação. O debate mudará da questão de se a IA importa para a rapidez com que seus efeitos estão se difundindo, quem está ficando para trás e quais investimentos complementares melhor transformam a capacidade da IA ??em prosperidade generalizada.

"Os debates sobre o impacto econômico da IA finalmente darão lugar a uma mensuração cuidadosa."

Erik Brynjolfsson

Membro Sênior do HAI

A GenAI tenta contornar a empresa

Nigam Shah , Professor de Medicina e de Ciência de Dados Biomédicos, e Cientista de Dados Chefe da Stanford Health Care.

À medida que o interesse em torno do uso da IA Genética aumenta, os criadores dessas tecnologias ficarão frustrados com os longos ciclos de decisão nos sistemas de saúde e começarão a se dirigir diretamente ao usuário, na forma de aplicativos disponibilizados gratuitamente para o usuário final. Considere, por exemplo, iniciativas como os resumos de literatura da OpenEvidence e as respostas sob demanda a perguntas clínicas da AtroposHealth .

No âmbito tecnológico, veremos um aumento no uso de transformadores generativos que têm o potencial de prever diagnósticos, resposta ao tratamento ou progressão da doença sem a necessidade de rótulos específicos para cada tarefa.

Diante desse aumento nas soluções disponíveis, a necessidade de os pacientes conhecerem os fundamentos sobre os quais a "ajuda" da IA está sendo fornecida se tornará crucial (veja meu comentário anterior sobre isso). A capacidade dos pesquisadores de acompanhar os avanços tecnológicos por meio de uma boa avaliação comparativa será limitada, mesmo que sua importância seja amplamente reconhecida. E veremos um aumento nas soluções que capacitam os pacientes a terem autonomia em seus próprios cuidados (por exemplo, este exemplo envolvendo o tratamento do câncer).

"Estamos num momento importante de reflexão para pensarmos sobre o que realmente queremos da IA."

Diyi Yang

Professor Assistente de Ciência da Computação

Aprimorando a interação humano-IA para benefícios a longo prazo

Diyi Yang , Professor Assistente de Ciência da Computação

É necessário investir mais no desenvolvimento de sistemas de IA que possam gerar benefícios a longo prazo. Com a crescente bajulação demonstrada nos LLMs (Licensed Licensing Management), o uso cada vez maior desses dispositivos para saúde mental e companhia, e a influência da IA no pensamento crítico e em habilidades essenciais, chegamos a um importante momento de reflexão sobre o que realmente queremos da IA e como alcançar esse objetivo.

Pessoalmente, gostaria de ver mais iniciativas voltadas para o desenvolvimento de sistemas de IA centrados no ser humano, que sejam não apenas tecnicamente capazes, mas também significativamente conectados à forma como as pessoas pensam, interagem e colaboram. Isso exige ir além da otimização de sistemas de IA para engajamento ou satisfação a curto prazo e, em vez disso, priorizar como as interações humano-IA moldam o desenvolvimento e o bem-estar dos usuários a longo prazo. Precisamos de sistemas de IA que ampliem as capacidades humanas, e isso precisa ser incorporado ao processo de desenvolvimento de IA desde o início, e não tratado como um problema de alinhamento posterior.

Esta matéria foi originalmente publicada pelo Instituto Stanford de Inteligência Artificial Centrada no Ser Humano.